¿ChatGPT nos atrofiará el cerebro?

Javier Gil, 15 Julio, 2025

Respuesta corta: No lo creo.

Respuesta larga, vamos a echar un vistazo al informe del MIT.

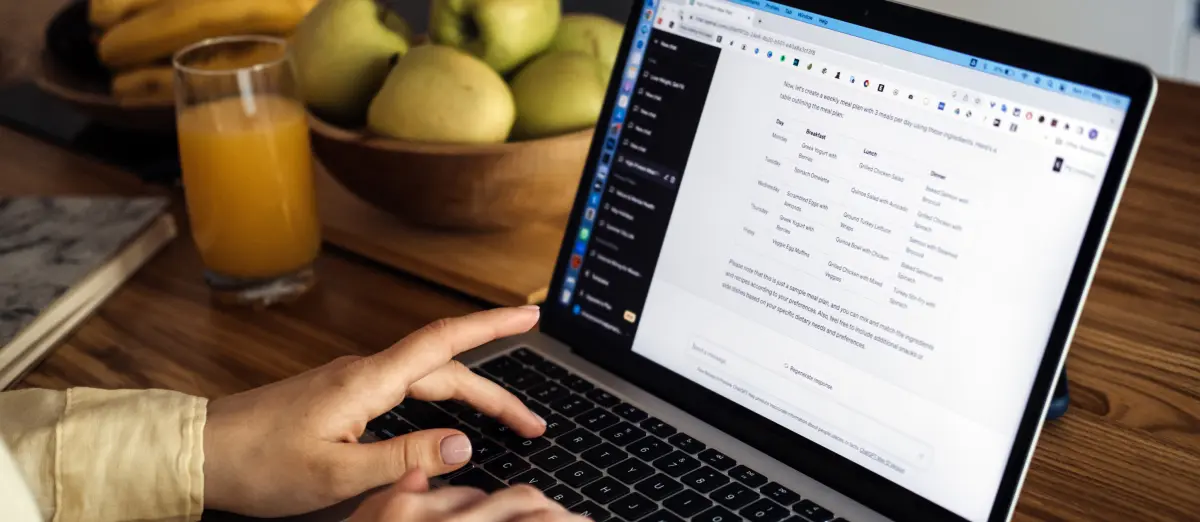

Se trata de un estudio preliminar que está circulando por redes y medios de comunicación que pone sobre la mesa una muy buena pregunta: ¿qué pasa en nuestro cerebro cuando usamos ChatGPT para trabajar? ¿Estamos ganando tiempo o perdiendo capacidades cognitivas?

El informe, titulado "Your Brain on ChatGPT", explora los efectos neurológicos y productivos del uso de modelos de lenguaje en tareas profesionales.

El equipo del MIT dividió a los participantes (54 personas) en tres grupos:

- Solo cerebro: escribían textos desde cero, sin ayuda.

- Google: podían usar el buscador para informarse.

- ChatGPT: solo podían redactar a través de la IA.

Durante el estudio, se monitorizó la actividad cerebral de los participantes con escáneres EEG. Esto será clave para entender los resultados del informe.

Todos los textos fueron revisados tanto por otras personas como por herramientas automáticas con inteligencia artificial. Además los participantes tendrían entrevistas cualitativas sobre sus resultados.

Después de tres sesiones, tuvieron una cuarta —cuatro meses después— en la que, sin previo aviso, los grupos fueron intercambiados. Es decir, quienes no usaron ChatGPT al principio pudieron usarlo en esa última sesión, y viceversa.

Los resultados fueron claros

Quienes usaron la IA desde el principio y luego escribieron sin ella, activaron un 50% menos su cerebro durante la escritura. Sus textos fueron más planos y el 83% olvidó lo que había redactado minutos instantes después.

A medida que se confiaba más en la IA, surgía una tendencia a copiar y pegar sin reelaborar, lo que los investigadores llamaron pereza metacognitiva.

En cambio, quienes no usaron la IA al principio tuvieron un aumento de su actividad cerebral, afianzaron los conocimientos sobre lo redactado y produjeron textos más claros y estructurados.

Con el cambio, lograron un mejor equilibrio: ganaron eficiencia y aumentaron su implicación cognitiva. Incluso completaron sus tareas un 25% más rápido y su calidad percibida por los jueces fue un 40% mejor.

Delegar sí, pero con cabeza

Este estudio, aún preliminar y con una muestra baja de participantes, no parece que busque demonizar a la inteligencia artificial, sino poner sobre la mesa que: la herramienta no es el problema, sino cómo la usamos.

Delegar tareas cognitivas no es nuevo. Lo hacemos cada día, y no solo con la IA:

- Apuntamos en la agenda los eventos más importantes para no olvidarlos.

- ¿64x35? Con papel y boli lo calculamos, pero usamos la calculadora.

- No recordamos números de teléfono porque el móvil ya lo hace por nosotros.

- El GPS facilita nuestro día a día con el coche en ciudades tan grandes como Madrid.

Lo que cambia con estas herramientas es la naturaleza de lo que delegamos: ya no son sólo tareas logísticas, sino también fases del proceso creativo, analítico y estratégico, donde antes se requería un mayor compromiso cognitivo.

Esto no es nuevo: existe una teoría conocida como “la mente extendida”, que plantea que nuestro cerebro no se debilita al delegar, sino que se expande, liberando carga mental para centrarse en lo que realmente importa: interpretar, decidir, crear.

Por eso es fundamental usar la IA sin desconectarnos del proceso de pensar.

Recomendaciones prácticas para usar ChatGPT (y no atrofiarte por el camino)

- Haz tú primero el esfuerzo. Redacta un primer borrador antes de pedir ayuda a la IA. Tu cerebro se activa más cuando tiene que construir desde cero.

- Usa ChatGPT como revisor o catalizador, no como redactor principal. Pídele ideas, sugerencias o reestructuraciones, pero mantén el control de la voz y el enfoque.

- Hazle buenas preguntas. Cuanto mejor formules tus prompts, más trabajarás tu capacidad de análisis. Sin duda, esto es lo que más estoy trabajando. Consejo extra: Háblale, no escribas. Es impresionante la capacidad de transcripción de sus audios o del modo conversación. El lenguaje natural es el mejor medio si sabes cómo estructurar los prompts.

- Relee y reescribe. Aunque te guste el resultado que ofrece la IA, no copies y pegues sin más. Modifica, ajusta, piensa.

¿Y en Góbalo?

En mi día a día como Responsable de Desarrollo Web en Góbalo, he encontrado múltiples formas de aplicar esta delegación cognitiva con sentido. Por ejemplo:

En procesos de documentación técnica o en propuestas, a veces lanzo un primer esquema preparado por mí o por el equipo y luego le pido a la IA que nos ayude a pulir el estilo o completar secciones.

Para generar expresiones regulares complejas, consultas SQL muy largas e incluso generar automáticamente fragmentos de código repetitivo en scripts o migraciones, ChatGPT también puede ser un recurso útil, siempre y cuando sepamos validar y ajustar su salida.

Incluso en tareas de QA o revisión de código, herramientas como Codex de OpenAI pueden aportar insights si se las guía correctamente.

Pero la validación y la responsabilidad última siempre recaen en el equipo humano.

La clave está ahí: en entender que la inteligencia artificial puede ser un acelerador, pero no un piloto automático.

Artículo redactado por:

Javier Gil, Responsable de Desarrollo Web